Создание robots.txt для wordpress |

|

|---|---|

|

16 Ноября 2013 22:32 |

|

|

Приветствую, марафоновцы! Сегодня мы более углубленно познакомимся с файлом robots.txt и выделим подходящий вид данного файла для своего блога на движке Wordpress.

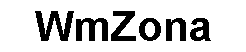

Что же такое robots.txt?Robots.txt - это текстовый документ, который размещается в корневой папке вашего сайта и предназначен для общения с поисковыми роботами посредством специальных директив, размещенных в этом файле. При помощи данного файла мы сможем указывать роботам, какие элементы и страницы своего блога мы разрешаем индексировать, а какие запрещаем к индексации. Во-первых, файл необходим для того, чтобы упростить работу поисковых устройств и во-вторых для того, чтобы закрыть от индексации не важные страницы, папки сайта, в том числе и дубли, которые часто можно встретить на сайтах, работающих на движке Wordpress. Роботы, которые попадают на ваш сайт, а их довольно много, первым делом ищут общее с ними, а именно файл Robots.txt. Они сканируют его и индексируют только то, что разрешено в этом файле. Шапка robots.txtСтруктура файла начинается с директивы User-agent . Используется она для обращения к поисковому роботу. Мы можем обратиться ко всем существующим роботам, а можем обратиться только к определенному. Так, если я хочу, чтобы мое обращение услышали роботы всех поисковых машин, то я прописываю директиву и ставлю после нее звездочку *, что означает «для всех роботов»: User-agent: * Но если я желаю, чтобы файл был просканирован определенно роботом Яндекса, я прописываю: User-agent: Yandex Директиву User-agent можно использовать для каждого робота в отдельности. Тоесть, мы можем для всех роботов указать одни значения, а для робота Яндекса – другие. Так, к примеру, обращаясь ко всем роботам, я могу не закрывать от индексации картинки, а в обращении к роботу Яндекса я могу их закрыть вот таким образом (картинки находятся в папке uploads родительской папки wp-content): User-agent: Yandex Disallow: /wp-content/uploads/ Основные директивы robots.txtТеперь рассмотрим, как же закрывать от индекса и открывать для индекса необходимые нам страницы и папки. В данном файле основными директивами являются:

Так, к примеру, если мы хотим закрыть от индексации шаблон или тему, которые находятся в папке /wp-content/ нашего сайта, мы прописываем: Disallow: /wp-content/ Но если мы хотим открыть для индексации картинки, которые расположены в папке /uploads/, а та в свою очередь лежит в папке /wp-content/, мы используем директиву Allow:  Тоесть, таким образом, мы указываем роботу, чтобы он не индексировал папку /wp-content/. При этом мы говорим ему, чтобы он обратил внимание на папку /uploads/, в которой находятся необходимые для индексации картинки блога и которая расположена в родительской папке /wp-content/. Также имеет значение и порядок использования таких директив. Тоесть, если вы напишите следующим образом, то картинки не будут индексироваться, потому как изначально будет исполняться первая директива Disallow: Disallow: /wp-content/ Allow: /wp-content/uploads/ Поэтому важно помнить, что при использовании таких директив сначала идет директива Allow, а потом уже Disallow. Вот пример использования директивы Disallow:  Как вы можете видеть для запрета и разрешения индексации после директив мы используем левый слеш - /. Он может восприниматься по-разному. Посмотрим на примере страницы «obo-mne»:

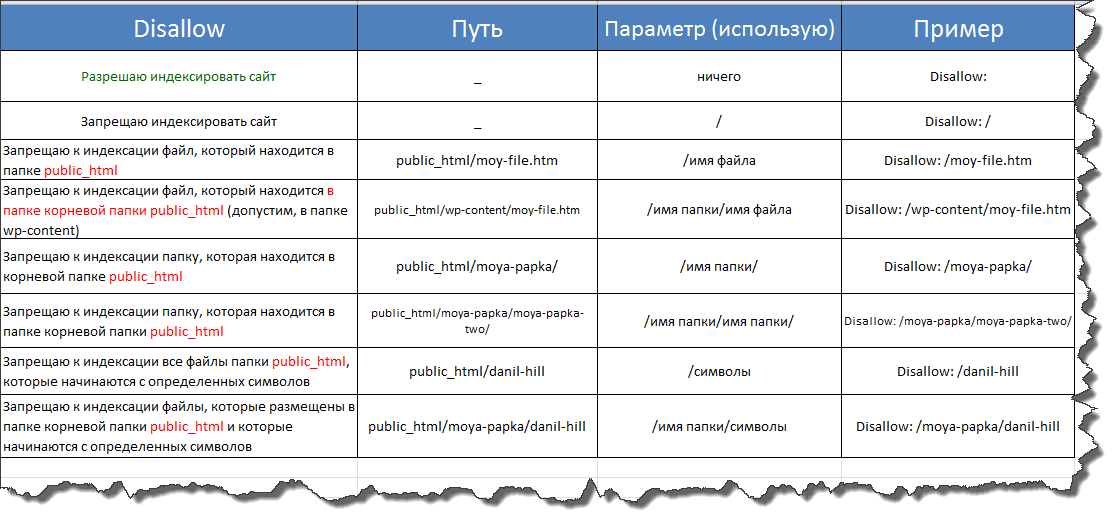

Значение «*» и «$» в robots.txtВ файле robots мы можем использовать значения * и $. Disallow: /obo-mne/* . Так мы прописываем, к примеру, в том случае, если у нас имеется категория, в которой есть страницы с концовкой .html и без нее. Тоесть, мы можем закрыть от индекса страницы в категории, которые имеют окончание .html ,а страницы без данной концовки будут индексироваться: Disallow: /obo-mne/*.html Также мы можем сделать наоборот: открыть от индекса все страницы с окончанием .html и закрыть от индекса страницы без данного окончания: Allow: /interesnoe/*.html Disallow: /interesnoe/ Мы уже знаем, что значение Disallow: / obo-mne закрывает от индекса сам раздел и страницы, которые содержат в себе «obo-mne». Так вот, добавляя в конце строки символ $ (доллар), мы указываем роботу, чтобы он не индексировал страницу / interesnoe, но индексировал записи типу /interesnoe-obo-mne и т.п.: Disallow: /interesnoe$ Директива Host в robots.txtЭта директива указывает роботу домен нашего сайта. Ставится же обычно после директив Disallow и перед директивой Sitemap. Однако так как эта директива является межсекционной, то робот будет учитывать ее в любом месте файла. Пример: Host: my-site.ru При этом нельзя использовать наклонные слеши и http. Sitemap в robots.txtВ файле роботс нам необходимо также прописать путь к карте своего сайта (ранее мы создавали ее при помощи Google XML). Директива карты сайта следующего вида: Sitemap: http://my-site.ru/sitemap.xml Обычно карта сайта указывается в файле robots.txt в самом конце и разделяется через пустую строку операторов. Пример Robots.txtНа основе вышеуказанных данных можно вывести полноценный файл robots для движка Wordpress. Я ранее указывал ссылку на скачивание данного файла: скачать его вы можете с Яндекс.Диска. Для того чтобы установить файл robots.txt разместите его в папку public_html своего сайта, не меняя названия и регистр букв. Выглядит же он, как я раньше показывал, следующим образом (в нем закрыты и элементы, создающие дубли):  Теперь, когда вы знаете основные моменты разобранного нами файла, вы сможете управлять индексацией своего сайта: запрещать и открывать к индексации желаемые вами файлы, папки и страницы. На главную курса Блог своими руками |

|

|

17 Ноября 2013 00:11 |

|

|

Вопрос сразу где написано что алоу воспринимается?

|

|

|

17 Ноября 2013 00:19 |

|

|

Михаил Ковалев: в моей статье написано и уважаемый Яндекс об этом говорит) Директивы используются совместно.)

|

|

|

17 Ноября 2013 03:40 |

|

Данил Хилл писал(а): яндекс мной не уважаем....это не корпороция добра, но без коментариев..... |

|

|

17 Ноября 2013 03:48 |

|

|

кстате на скока знаю ( не претендую на истину первой инстанции).........роботс сотворен именно с мыслью запрета.......если я не прав............то восприйму критику и все остальное........

|

|

|

17 Ноября 2013 10:20 |

|

|

Данил Хилл: Отличная статья! Главное написана доступным языком для начинающих. Спасибо!

|

|

|

13 Мая 2014 21:12 |

|

|

Люди подскажите пожалуйста, как ускорить индексацию? У меня новостной блог и хотелось бы чтобы новости немедленно попадали в поисковую систему.

|

|

|

13 Мая 2014 21:35 |

|

|

Серий Васильович: добавь свой rss в ленту новостей яндекса, получишь немедленное попадание.

p.s. с чего ты взял что у тебя новостной блог? что вообще такое по твоему новостной блог? ты вообще понимаешь что называется блогом? ты Серий у себя в голове ничего не перепутал? а то если ты там у себя без понятия всякую фигню строчишь и радуешься, это же не блог, и не новости... это же Серий у тебя сплетни там собираются, а следовательно ты Серий сплетник и пустомеля... тебе БАН надо сию секунду с поиска выдать, чтобы ты Серий слухи необоснованные распускать перестал... Может у тебя и журналисты в штате имеются? ну раз уж ты себя новостями причесываешь, может... может... может... p.s.2. админы и модераторы полезных и познавательных сайтов такие вопросы не задают... да и развлекательных кстати тоже... |

|

|

14 Мая 2014 07:09 |

|

Vip WMzona писал(а): спасибо |

|

|

4 Декабря 2015 10:40 |

|

|

Первый раз слышу о роботе.

|

|

|

12 Декабря 2015 11:02 |

|

|

А что значит в конце:

Disallow: /*?* Disallow: /?s= |

|

|

12 Декабря 2015 11:21 |

|

Dmitriy Shiryaev писал(а): Disallow: /*?* - не индексируются ссылки имеющие после слеша (/) вопросительный знак Disallow: /?s - хрень какая-то |

|

|

16 Декабря 2015 08:46 |

|

Valera Goryachev писал(а): Disallow: /?s= закрытие от индексации страниц на сайте без ЧПУ |

|

|

19 Февраля 2017 21:58 |

|

|

С этим файлом я очень долго провозился,сайт долго не индексировался через то что почемуто в моем шаблоне этого файла небыло вообше,а зачем что то там прятать от индексации пусть индексирует все .

|

|

Последние сообщения:

-

Арбитраж вмзоны

Такое ощущение, что мы пишем сами себе. Реакции но

Такое ощущение, что мы пишем сами себе. Реакции но -

Тизерная сеть autoteaser

I used this to clean up a photo before posting it

I used this to clean up a photo before posting it -

ТОП-3 способа начать зарабатывать в инте

When I first started exploring ways to earn money

When I first started exploring ways to earn money -

Заработок на форумах

Я работаю курьером в доставке еды. Не самом крутом

Я работаю курьером в доставке еды. Не самом крутом -

The best and friendly earning website I

This post was both engaging and easy to read. I ap

This post was both engaging and easy to read. I ap